La inteligencia artificial podría conducir a la extinción de la humanidad, han advertido los expertos, incluidos los jefes de OpenAI y Google Deepmind.

Por Chris Vallance – BBC

Docenas han apoyado una declaración publicada en la página web del Centro para la Seguridad de la IA .

«Mitigar el riesgo de extinción de la IA debería ser una prioridad global junto con otros riesgos a escala social como las pandemias y la guerra nuclear», se lee.

Pero otros dicen que los temores son exagerados.

Sam Altman, director ejecutivo de OpenAI, fabricante de ChatGPT, Demis Hassabis, director ejecutivo de Google DeepMind y Dario Amodei de Anthropic han apoyado la declaración.

El sitio web del Center for AI Safety sugiere una serie de posibles escenarios de desastre:

- Las IA podrían convertirse en armas; por ejemplo, las herramientas de descubrimiento de drogas podrían usarse para construir armas químicas.

- La desinformación generada por IA podría desestabilizar a la sociedad y «socavar la toma de decisiones colectiva»

- El poder de la IA podría concentrarse cada vez más en cada vez menos manos, lo que permitiría a los «regímenes imponer valores limitados a través de una vigilancia generalizada y una censura opresiva».

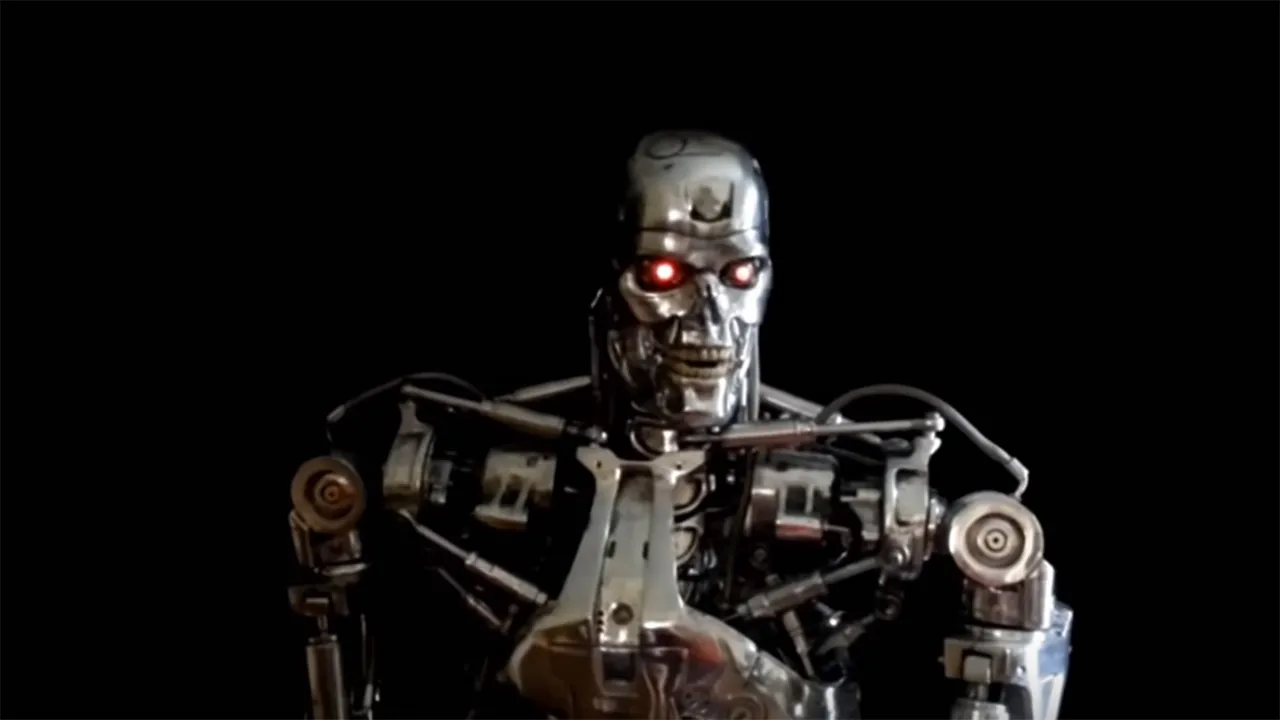

- Debilitamiento, donde los humanos se vuelven dependientes de la IA «similar al escenario retratado en la película Wall-E»

El Dr. Geoffrey Hinton, quien emitió una advertencia anterior sobre los riesgos de la IA súper inteligente, también apoyó la llamada del Centro para la Seguridad de la IA.

También firmó Yoshua Bengio, profesor de informática en la universidad de Montreal.

El Dr. Hinton, el profesor Bengio y el profesor de la NYU, Yann LeCun, a menudo se describen como los «padrinos de la IA» por su innovador trabajo en el campo, por el que ganaron conjuntamente el Premio Turing 2018, que reconoce contribuciones destacadas en informática.

Pero el profesor LeCun, que también trabaja en Meta, ha dicho que estas advertencias apocalípticas son exageradas al tuitear que «la reacción más común de los investigadores de IA a estas profecías de fatalidad es palmear la cara».

‘Fracturando la realidad’

Muchos otros expertos creen de manera similar que los temores de que la IA acabe con la humanidad son poco realistas y una distracción de problemas como el sesgo en los sistemas que ya son un problema.

Arvind Narayanan, científico informático de la Universidad de Princeton, le dijo anteriormente a la BBC que los escenarios de desastres similares a los de la ciencia ficción no son realistas: «La IA actual no es lo suficientemente capaz para que estos riesgos se materialicen. Como resultado, distrae la atención de la daños a corto plazo de la IA».

La investigadora asociada senior del Instituto de Ética en IA de Oxford, Elizabeth Renieris, le dijo a BBC News que le preocupaban más los riesgos más cercanos al presente.

«Los avances en IA magnificarán la escala de la toma de decisiones automatizada que es sesgada, discriminatoria, excluyente o injusta, al mismo tiempo que es inescrutable e indiscutible», dijo. «Impulsarían un aumento exponencial en el volumen y la difusión de información errónea, fracturando así la realidad y erosionando la confianza del público, y generarían una mayor desigualdad, particularmente para aquellos que permanecen en el lado equivocado de la brecha digital».

Muchas herramientas de IA esencialmente «viajan gratis» en «toda la experiencia humana hasta la fecha», dijo Renieris. Muchos están capacitados en contenido, texto, arte y música creados por humanos que luego pueden imitar, y sus creadores «han transferido efectivamente una enorme riqueza y poder de la esfera pública a un pequeño puñado de entidades privadas».

Pero el director del Centro para la Seguridad de la IA, Dan Hendrycks, le dijo a BBC News que los riesgos futuros y las preocupaciones actuales «no deben verse de manera antagónica».

«Abordar algunos de los problemas hoy puede ser útil para abordar muchos de los riesgos posteriores mañana», dijo.

Esfuerzos de superinteligencia

La cobertura mediática de la supuesta amenaza «existencial» de la IA se ha disparado desde marzo de 2023 cuando expertos, incluido el jefe de Tesla, Elon Musk, firmaron una carta abierta instando a detener el desarrollo de la próxima generación de tecnología de IA.

Esa carta preguntaba si deberíamos «desarrollar mentes no humanas que eventualmente podrían superarnos en número, ser más inteligentes, obsoletas y reemplazarnos».

En contraste, la nueva campaña tiene una declaración muy breve, diseñada para «abrir la discusión».

La declaración compara el riesgo con el que representa una guerra nuclear. En una publicación de blog, OpenAI sugirió recientemente que la superinteligencia podría regularse de manera similar a la energía nuclear: «Es probable que eventualmente necesitemos algo como un OIEA [Agencia Internacional de Energía Atómica] para los esfuerzos de superinteligencia», escribió la firma.

‘Tranquilízate’

Tanto Sam Altman como el director ejecutivo de Google, Sundar Pichai, se encuentran entre los líderes tecnológicos que recientemente discutieron la regulación de la IA con el primer ministro.

En declaraciones a los periodistas sobre la última advertencia sobre el riesgo de la IA, Rishi Sunak destacó los beneficios para la economía y la sociedad.

«Usted ha visto que recientemente estaba ayudando a las personas paralizadas a caminar, descubriendo nuevos antibióticos, pero debemos asegurarnos de que esto se haga de una manera segura», dijo.

«Es por eso que me reuní la semana pasada con los directores ejecutivos de las principales empresas de inteligencia artificial para discutir cuáles son las medidas de seguridad que debemos implementar, cuál es el tipo de regulación que se debe implementar para mantenernos a salvo.

«La gente estará preocupada por los informes de que la IA plantea riesgos existenciales, como pandemias o guerras nucleares.

«Quiero que se aseguren de que el gobierno está analizando esto con mucho cuidado».

Había discutido el tema recientemente con otros líderes, en la cumbre del G7 de las principales naciones industrializadas, dijo Sunak, y pronto lo plantearía nuevamente en los EE. UU.

El G7 ha creado recientemente un grupo de trabajo sobre IA.